Tema

Procesamiento de Datos con Spark Core desde HDFS

Instrucciones

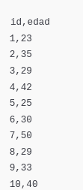

Datos:

Crea un archivo .csv con siguiente estructura

Súbelo a HDFS

Carga de Datos desde HDFS:

Carga el archivo CSV usuarios.csv desde HDFS en un DataFrame de Spark.

Transformaciones:

Usa una transformación select para seleccionar solo las columnas id y edad.

Usa una transformación filter para filtrar solo a los usuarios con edad mayor a 30 años.

Usa una transformación withColumn para crear una nueva columna llamada edad_doble que contenga el doble de la edad de cada usuario.

Acciones:

Usa una acción show() para mostrar las primeras 5 filas del DataFrame resultante después de las transformaciones.

Usa una acción count() para contar cuántos usuarios tienen más de 30 años.

Escritura de Resultados a HDFS:

Escribe el DataFrame resultante (usuarios con edad mayor a 30 y columna edad_doble) en un nuevo archivo CSV en HDFS en la ruta /user/usuario/resultados_usuarios/. Revisa la documentación de spark

Guarda los comandos usados y las salidas obtenidas en un archivo .pdf, comenta el código para saber qué es lo que se hizo.

Tipo de entrega: Archivo en PDF

- 7 de enero de 2026, 17:55